[이코노믹데일리] 세계 최대 클라우드 서비스 기업(CSP)인 아마존웹서비스(AWS)가 엔비디아의 독주를 막기 위해 자체 개발한 차세대 인공지능(AI) 칩 ‘트레이니엄3(Trainium3)’를 공개했으나 시장의 반응은 냉담하다. 전작 대비 효율이 좋아졌다는 주장 외에 객관적인 성능 지표를 공개하지 않아 경쟁사인 구글이나 엔비디아의 최신 칩과 비교해 기술적 우위를 증명하지 못했다는 평가가 지배적이다.

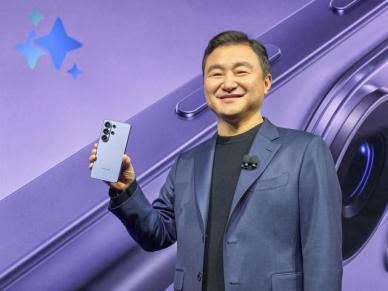

AWS는 지난 2일(현지시각) 미국 라스베이거스에서 개막한 연례 기술 콘퍼런스 ‘리인벤트(re:Invent) 2025’에서 자사의 최신 AI 학습용 칩 ‘트레이니엄3’를 전격 공개했다.

맷 가먼 AWS 최고경영자(CEO)는 기조연설을 통해 “트레이니엄3는 전작인 트레이니엄2 대비 컴퓨팅 성능을 4배 이상 끌어올렸고 에너지 소비량은 40%가량 낮췄다”며 “운영 비용을 최대 50% 절감할 수 있는 효율적인 칩”이라고 강조했다. 이는 엔비디아 그래픽처리장치(GPU)에 대한 높은 의존도를 낮추고 비용 효율성을 앞세워 자체 하드웨어 생태계를 확장하겠다는 전략으로 풀이된다.

하지만 업계 전문가들은 AWS의 발표가 ‘알맹이 없는 선언’에 불과하다고 지적한다. AI 칩의 성능을 가늠하는 핵심 지표인 ‘플롭스(FLOPS, 초당 부동소수점 연산 횟수)’나 대규모언어모델(LLM) 구동 시의 벤치마크 점수를 전혀 공개하지 않았기 때문이다.

최근 구글이 자체 칩인 텐서처리장치(TPU) 최신 버전을 공개하며 자사의 AI 모델 ‘제미나이’를 학습시킬 때의 성능, 전력 효율, 속도 등을 구체적인 수치로 제시한 것과는 대조적인 행보다.

특히 엔비디아의 주력 제품군인 H100, H200, GB200 등과의 직접적인 비교 수치가 빠져 있다는 점이 의구심을 키우고 있다. AWS가 내세운 ‘전작 대비 4배 성능 향상’은 자사 제품 간의 비교일 뿐 현재 AI 칩 시장의 표준으로 자리 잡은 엔비디아 GPU와 견줘 어느 정도의 경쟁력을 갖췄는지 판단하기 어렵다.

전작인 트레이니엄2 역시 가성비 모델로 포지셔닝됐을 뿐 절대적인 성능 면에서는 GPU에 크게 미치지 못했다는 점을 고려하면 이번 신제품 역시 고성능 AI 학습 시장의 판도를 바꾸기에는 역부족일 것이라는 분석이 나온다.

대규모 AI 인프라 구축의 핵심인 ‘클러스터링’ 기술에 대해서도 우려가 제기된다. AWS는 트레이니엄3를 통해 최대 10만 개 규모의 칩 클러스터를 구성할 수 있다고 발표했다. 그러나 수만 개의 칩을 하나처럼 연결해 연산할 때 발생하는 데이터 병목 현상과 동기화 문제를 어떻게 해결했는지에 대한 기술적 설명은 부재했다. 10만 개의 칩을 물리적으로 연결하더라도 통신 속도와 효율이 뒷받침되지 않으면 실제 학습 성능은 기대에 미치지 못할 수 있다.

데이터센터 운영 비용의 핵심인 발열 관리(Thermal Throttling) 데이터가 빠진 점도 약점으로 꼽힌다. AWS는 전력 효율성을 강조했으나 실제 고부하 작업 시 칩의 발열을 제어하는 능력이나 이에 따른 실전 운영 데이터는 제시하지 않았다. 이는 엔비디아나 구글이 칩 설계 단계부터 발열 제어와 전성비(전력 대비 성능) 최적화에 사활을 걸고 구체적인 데이터를 공개하는 것과 비교해 신뢰도를 떨어뜨리는 요인이다.

소프트웨어 최적화 측면에서도 경쟁력이 모호하다는 지적이다. 구글의 경우 자사 TPU를 AI 모델 ‘제미나이’에 최적화해 학습 성능을 극대화한 반면 AWS의 트레이니엄 시리즈는 범용성을 지향하다 보니 특정 고성능 모델에서의 최적화 수준이 상대적으로 낮다. GPU 대신 트레이니엄을 사용할 경우 대규모 학습 모델에서 AI 서비스 품질 저하가 발생할 수 있다는 우려가 나오는 이유다.

클라우드 업계의 한 관계자는 “이번에 공개된 트레이니엄3의 연산 능력은 엔비디아의 현역 최신 모델인 블랙웰(Blackwell) 시리즈는커녕 이전 세대인 H100보다도 낮은 수준으로 추정된다”며 “클라우드 환경에 특화된 설계로 비용 절감 효과는 있겠지만 고도의 연산 능력이 필요한 첨단 AI 학습 영역에서 엔비디아 GPU를 대체하기는 어려울 것”이라고 평가했다.

Copyright © 이코노믹데일리, 무단전재·재배포 금지